告别“仿真等不起”!UltraLAB为CAE工程计算定制“加速引擎”,效率提升不止50%

导语:

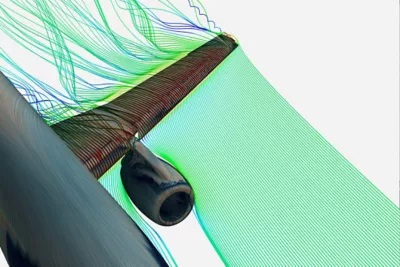

在结构力学、流体动力学(CFD)或电磁场仿真中,工程师常面临一个核心矛盾:模型精度要求越高,计算耗时就越长。一次复杂的整车碰撞、一个精细的湍流模拟,往往需要数十小时甚至数天的等待,严重拖慢了研发与项目进度。

如何在不牺牲精度的前提下,突破算力瓶颈?深耕高性能计算定制十余年的UltraLAB,基于对CAE仿真底层算法与硬件架构的深刻理解,给出了答案。

痛点:通用工作站,难以应对专业算法的“偏科”需求

许多团队以为,买一台“顶配”电脑就能搞定所有仿真。但现实是,不同的算法对硬件资源的“胃口”截然不同:

-

做结构静力学分析(FEM),需要极高的单核频率与内存带宽;

-

跑流体仿真(FVM),考验的是多核心并行效率与海量内存;

-

进行电磁场求解(MoM/MLFMM),则对CPU缓存和浮点运算能力提出严苛要求。

用一套通用的配置去应付所有场景,结果往往是“高配低能”,算力被大量浪费。

UltraLAB解决方案:为算法而生,让硬件“读懂”软件

UltraLAB的做法是,先分析您的软件算法,再反向定制硬件架构。根据官网最新发布的“2025v3工程仿真计算工作站”配置方案,其核心策略如下:

1. 针对算法特性,精准配置计算核心

-

为有限元分析(FEM)提速:针对ANSYS、Abaqus等软件,推荐采用高主频、大缓存处理器(如Intel Xeon W9-3495X超频至4.8GHz,或AMD霄龙9475F),并搭配高带宽DDR5内存,确保网格剖分与矩阵求解阶段的速度。

-

为计算流体力学(CFD)增效:面对Fluent、Star-CCM+等软件的有限体积法(FVM)需求,主推高并发多核处理器(如双路AMD霄龙9755,高达256核),并配置大容量内存(最高3TB),让大规模并行计算不再“卡顿”。

-

为电磁仿真(EM)赋能:针对HFSS、CST等软件的矩量法(MoM)和多层快速多极子(MLFMM)算法,提供高频处理器与大缓存组合,加速矩阵填充与求解过程。

2. 不止于CPU,构建全链路加速平台

-

GPU加速:为支持GPU求解的软件(如ANSYS Mechanical、Fluent),可选配NVIDIA A100、H100或RTX 5880Ada显卡,将部分计算负载转移至GPU,实现数量级提速。

-

存储无瓶颈:采用闪存阵列技术,彻底消除超大规模模型(如整机气动噪声分析)的数据读取和写入延迟。

-

系统级调优:通过超频技术、虚拟并行计算、低延迟响应等自有技术,确保硬件资源100%用于计算,而非被系统开销浪费。

成效:从“人等结果”到“结果等人”

以某航空研究所引入UltraLAB “高频极致计算型” 工作站(配置:双路AMD霄龙9475F处理器,96核@4.5GHz,768GB内存)为例:

-

挑战:对一个全机翼的跨音速颤振(流固耦合)模型进行仿真,原集群需耗时 36小时 且需排队等待。

-

UltraLAB成效:

-

计算时间缩短62%:单次求解时间压缩至 14小时以内,工程师可在当天上班时提交,次日清晨拿到完整结果。

-

迭代次数翻倍:原本每周只能进行2次设计验证,现在可以轻松完成5次,项目周期从3个月缩短至1.5个月。

-

模型精度提升:算力充裕后,团队敢于将网格数量从800万加密至1500万,仿真结果与后续风洞实验的误差从15%降低至3%以内。

-

UltraLAB的价值主张

正如其官网所述,UltraLAB的目标是 “保证最短时间完成计算,机器使用率最大化,事半功倍”。他们提供的不仅是硬件,更是一套经过深度优化的计算解决方案。

无论您是进行:

-

结构力学的强度与疲劳分析,

-

流体力学的气动优化与热管理,

-

电磁场的天线与兼容性设计,

-

还是复杂的多物理场耦合……

UltraLAB都能从数十款精细化配置中(如官网列表所示),为您匹配那台“最完美、最快”的专属工作站。

让您的仿真计算,从此快人一步。

[立即咨询 UltraLAB],获取为您行业定制的性能提升方案与远程测试支持。

电话/微信/QQ:13772131799