跨平台编译难?容器仿真慢?UltraLAB为边缘智能破局

时间:2026-03-27 16:53:07

来源:UltraLAB图形工作站方案网站

人气:102

作者:fzm

从云端模型压缩到边缘端部署,中间横亘着跨平台编译、算子适配、性能验证三道鸿沟。Docker容器化隔离、TensorRT/ONNX加速推理、QEMU跨架构仿真——边缘智能开发对工作站的要求,不是单点算力的极致,而是全流程验证环境的一致性。本文深度解构边缘智能仿真的计算特征,并提供UltraLAB精准匹配的硬件方案。

边缘智能正成为AI落地的重要战场。无论是自动驾驶的车载推理、工业质检的端侧部署,还是智能摄像头的实时分析,其开发流程都遵循统一的范式:云端训练→模型压缩→跨平台编译→边缘仿真验证→实际部署。在这一链条中,Docker提供环境一致性,TensorRT/ONNX实现推理加速,QEMU完成跨架构仿真——而支撑这一切的硬件平台,必须具备高主频CPU、充足内存、高速存储、专业级GPU的“铁三角”配置。

一、边缘智能仿真的计算特征与硬件瓶颈

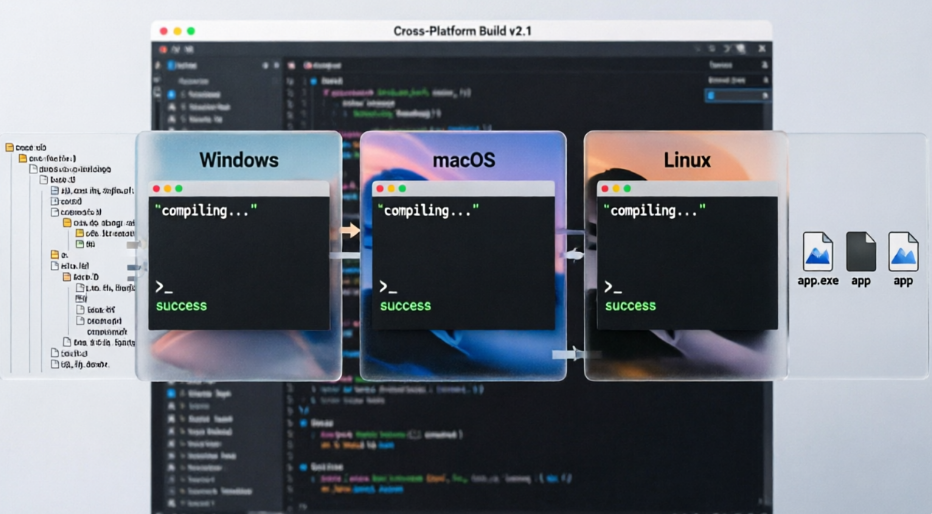

1. 跨平台编译:从x86到ARM的架构鸿沟

边缘设备普遍采用ARM架构(如树莓派、NVIDIA Jetson、手机SoC),而开发环境多为x86工作站。跨平台编译面临:

-

交叉编译工具链:需要为目标架构(ARM64、ARMv7)编译依赖库(OpenCV、TensorFlow Lite)

-

指令集差异:x86的AVX指令与ARM的NEON指令无法直接兼容,需重新优化

-

编译时间:完整系统镜像(如Yocto、Buildroot)编译可达数小时至数十小时

硬件要求:

-

高主频CPU(≥5.0GHz):交叉编译多为CPU密集型,单核性能决定编译速度

-

多核心(≥16核):支持并行编译(make -j16),显著缩短编译时间

-

大容量内存(≥64GB):大型项目(如Android AOSP)编译需内存缓存海量中间文件

2. 轻量化推理验证:TensorRT/ONNX的精度对齐

模型从FP32导出到FP16/INT8,需验证精度损失:

-

TensorRT优化:算子融合、层间重构、量化校准,涉及大量矩阵运算

-

ONNX转换:导出、算子兼容性验证、输入输出对齐

-

精度对比:在相同输入下比对FP32与INT8输出的差异(峰值信噪比、余弦相似度)

硬件要求:

-

高性能GPU(RTX 4090/5090及以上):加速TensorRT的优化与校准过程

-

大显存(≥24GB):支持大模型(如YOLOv8-L、SAM)的量化校准

-

Tensor Core支持:RTX 30/40/50系列均具备,显著加速INT8/FP8运算

3. 容器化仿真:Docker环境的一致性保障

边缘部署前需在容器中完整模拟边缘环境:

-

容器内编译运行:在Docker容器中执行交叉编译、推理验证

-

多容器并发:同时测试多个模型版本(如FP32、FP16、INT8)在不同依赖环境下的表现

-

虚拟化开销:Docker原生性能损耗约1-2%,但需足够内存支撑多容器运行

硬件要求:

-

大容量内存(≥128GB):支持同时运行5-10个容器(每个容器内存预留8-16GB)

-

高速NVMe存储(≥2TB):存储多个版本的Docker镜像、模型文件、数据集

-

CPU核心数充足:多容器并发调度对CPU上下文切换能力要求高

4. QEMU全系统仿真:跨架构验证的“最后一道关卡”

在无法获得真实边缘设备时,QEMU可仿真ARM/RISC-V等目标架构:

-

用户态仿真:仿真单个可执行文件,开销较小(2-5倍性能损失)

-

系统态仿真:仿真完整操作系统(如Ubuntu ARM版),性能损失可达10-20倍

-

外设仿真:模拟GPIO、摄像头等接口,验证硬件交互逻辑

硬件要求:

-

高主频CPU:QEMU仿真极度依赖单核性能,每1GHz主频提升带来线性加速

-

超大内存(≥256GB):系统态仿真需为目标系统分配独立内存空间

-

存储I/O性能:QEMU镜像文件(如qcow2)的随机读写直接影响仿真体验

二、UltraLAB边缘智能仿真硬件方案

方案A:边缘AI开发全能工作站

适用场景:模型量化与TensorRT优化、多容器并行验证、QEMU全系统仿真

性能预估:

-

YOLOv8-L INT8量化校准:TensorRT优化从原45分钟压缩至12分钟

-

完整边缘系统镜像编译(Buildroot):原2小时压缩至35分钟

-

QEMU用户态仿真:性能损耗控制在3-5倍(vs 原10倍)

方案B:云端-边缘协同仿真集群节点

适用场景:多版本模型批量验证、CI/CD自动化测试、大规模数据集仿真

性能预估:

-

支持10个模型版本同时进行TensorRT优化与精度验证

-

CI/CD流水线:从代码提交到生成边缘部署包,压缩至20分钟内

方案C:边缘智能原型开发与验证型

适用场景:单模型快速验证、轻量级交叉编译、个人开发者测试

性能预估:

-

YOLOv8-M INT8量化:TensorRT优化分钟

-

单模型交叉编译(ARM64):分钟

-

支持同时运行2-3个仿真容器

三、关键优化技术

1. Docker容器化优化

-

多阶段构建:将编译环境与运行环境分离,最终镜像体积可降低50-70%

-

构建缓存:将常用依赖层(如CUDA base、PyTorch)持久化,避免重复拉取

-

硬件适配:NVMe SSD的随机读性能(IOPS≥500k)显著提升容器启动速度

2. TensorRT/ONNX优化策略

-

精度校准:使用代表性数据集(100-1000张)进行INT8量化校准

-

算子融合:TensorRT自动融合卷积+BN+ReLU,减少内核启动开销

-

硬件适配:需GPU支持Tensor Core(RTX 20系列及以上),FP8加速需Ada Lovelace架构(RTX 40/50系列)

3. QEMU仿真加速

-

KVM加速:在x86主机上利用KVM虚拟化,可实现近原生性能(需CPU支持硬件虚拟化)

-

Tiny Code Generator:启用TCG的优化编译选项(如-enable-kvm -cpu host)

-

硬件要求:CPU需支持VT-x/AMD-V虚拟化技术,且内存需预留足够空间

4. 跨平台编译工具链优化

-

ccache:缓存编译中间对象,重复编译效率提升5-10倍

-

分布式编译:distcc/icecream将编译任务分发至多节点

-

硬件适配:多核心CPU + 高速网络(集群环境)

四、结语:仿真精度决定部署成功率

边缘智能的落地困境,往往不在于云端模型的能力,而在于边缘端能否“接得住”。跨平台编译的兼容性、轻量化推理的精度对齐、容器化环境的一致性——这些仿真环节的疏漏,可能导致模型在真实设备上性能衰减、精度下降甚至无法运行。

UltraLAB边缘智能仿真工作站,正是基于对这一开发流程的深度理解而设计。从高主频CPU加速交叉编译,到高性能GPU支撑TensorRT优化,再到大容量内存保障多容器并发验证——每一款产品的配置逻辑,都源自边缘智能开发者的真实痛点。让仿真无限接近真实,让部署一次成功。

如需针对具体目标架构(ARM64/RISC-V)、模型类型(CNN/Transformer)及仿真规模(单容器/集群化)的定制化配置,欢迎联系UltraLAB技术顾问团队。

UltraLAB图形工作站供货商:

西安坤隆计算机科技有限公司

国内知名高端定制图形工作站厂家

咨询微信号:

下一篇:没有了