深度学习训练、大模型微调、推理对存储服务器硬件配置推荐24v2

海量、高并发、不卡之王---N600C超级存储服务器硬件配置推荐

深度学习训练、大模型微调、推理对存储服务器硬件配置推荐24v2

深度学习训练:

- 存储容量: 训练数据集的大小决定了存储容量的需求。对于大型数据集,需要使用高容量的存储服务器。

- 存储性能: 训练过程中需要频繁地读写数据,因此需要高性能的存储服务器。推荐使用 NVMe SSD 等高性能存储介质。

- 可靠性: 训练过程中产生的模型文件非常重要,因此需要保证数据的安全性和完整性。推荐使用 RAID 等数据冗余技术来提高存储可靠性。

大模型微调:

- 存储容量: 微调需要加载训练好的模型文件,因此需要足够的存储容量。

- 存储性能: 微调过程中需要频繁地读写数据,因此需要高性能的存储服务器。

- 可靠性: 微调过程中产生的模型文件非常重要,因此需要保证数据的安全性和完整性。

推理:

- 存储容量: 推理需要加载训练好的模型文件,因此需要足够的存储容量。

- 存储性能: 推理过程中需要快速地读取数据,因此需要高性能的存储服务器。

- 可靠性: 推理过程中使用的模型文件非常重要,因此需要保证数据的安全性和完整性。

具体来说,深度学习训练、大模型微调、推理对存储服务器技术的要求如下:

|

环节 |

存储容量 |

存储性能 |

可靠性 |

|

深度学习训练 |

10TB - 100PB |

10GB/s - 100GB/s |

99.999% |

|

大模型微调 |

1TB - 10TB |

10GB/s - 100GB/s |

99.999% |

|

推理 |

100GB - 1TB |

1GB/s - 10GB/s |

99.99% |

以下是一些具体的建议:

- 对于小型深度学习项目,可以使用单台高性能存储服务器。

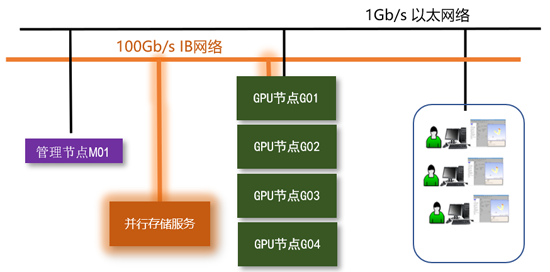

- 对于大型深度学习项目,可以使用多台存储服务器组成集群。

- 可以使用 Lustre、GPFS 等分布式文件系统来管理存储资源。

此外,深度学习训练、大模型微调、推理还需要考虑以下因素:

- 数据安全性: 深度学习模型可能包含敏感信息,因此需要采取措施保护数据安全。

- 数据访问权限: 需要根据用户的角色和权限来控制数据访问。

海量、高并发、不卡之王---N600C超级混合闪存存储服务器

上述所有配置,代表最新硬件架构,同时保证是最完美,最快,如有不符,可直接退货

欲咨询机器处理速度如何、技术咨询、索取详细技术方案,提供远程测试,请联系

UltraLAB图形工作站供货商:

西安坤隆计算机科技有限公司

国内知名高端定制图形工作站厂家

业务电话:400-705-6800

咨询微信号: